iOS 27 promet de changer la façon dont on parle à son téléphone. Plutôt que d’enchaîner des commandes séparées, Siri pourrait enfin comprendre et exécuter plusieurs actions formulées d’un trait : obtenir un itinéraire, l’envoyer à un contact, puis lancer la lecture d’un podcast sans réveiller l’assistant à chaque étape. Cette mise à jour, fruit d’un chantier intitulé Apple Intelligence ouvert en 2024, vise à transformer l’assistant vocal en une interface conversationnelle capable d’exploiter le contenu à l’écran, d’aller chercher des réponses sur le web et même de générer des images.

La bascule n’est pas qu’un tour de passe‑passe technique : elle questionne la vie privée, l’architecture des services et le rythme des déploiements. Apple teste une version autonome de Siri, des fonctions d’analyse de l’écran et un clavier doté d’IA pour suggestions grammaticales — des briques qui, assemblées, doivent offrir une amélioration utilisateur tangible. La démonstration est prévue à la WWDC, mais la promesse d’un assistant capable de traiter des requêtes multiples d’un seul énoncé reste soumise à des essais et à des étiquettes « Preview ». L’enjeu est simple : rester pertinent face à des chatbots déjà à l’aise avec des commandes simultanées.

À retenir : la mise à jour vise à rendre Siri conversationnel et multitâche, avec accès au web et au contenu local ; la distribution pourrait être progressive, certaines fonctions marquées « Preview » ; Apple explore aussi des partenariats et des modèles embarqués pour renforcer son offre d’intelligence artificielle.

Ce que la mise à jour iOS 27 change pour Siri

La promesse est claire : Siri passera d’un exécuteur de commandes simples à un vrai agent conversationnel capable de comprendre des enchaînements d’actions. Aujourd’hui, demander un itinéraire puis l’envoyer requiert deux interactions ; demain, cela pourrait se faire en une seule phrase. Cette évolution s’appuie sur une nouvelle couche de contexte personnel et d’accès aux apps, pensée pour agir « entre » les applications et non plus seulement « dans » chacune.

L’évolution n’est pas uniquement logique : elle implique une réécriture des autorisations, du traitement local versus cloud et des compromis entre personnalisation et confidentialité. L’effort se concentre sur une interaction vocale plus naturelle, sans sacrifier le contrôle utilisateur. Insight : la nouveauté utile sera celle qui combine polyvalence et transparence.

Comment les requêtes multiples transforment l’interaction vocale

Les requêtes multiples signifient que l’utilisateur peut enchaîner des verbes d’action sans segmenter sa pensée. Plutôt que d’ordonner « afficher l’itinéraire » puis « envoyer », on dira « trouve l’itinéraire vers ce café et partage‑le avec Paul ». Siri devra parser la phrase, planifier les étapes et exécuter les actions dans l’ordre approprié.

Pour l’utilisateur, le gain est évident : moins d’interruptions, plus de fluidité. Pour Apple, c’est un test d’orchestration : vérifier que la gestion des erreurs, des confirmations et des préférences personnelles reste sûre et compréhensible. Insight : la simplicité perçue découlera autant de la robustesse des choix par défaut que de la finesse du langage naturel.

Ce que Apple Intelligence apporte à l’assistant vocal

La mise à jour s’inscrit dans un programme baptisé Apple Intelligence, démarré en 2024. L’objectif est multiple : donner à Siri plus de contexte sur l’écran, la capacité de résumer du contenu web via une fonction type « World Knowledge Answers » et, potentiellement, d’intégrer la génération d’images via un module comme Image Playground.

Apple teste aussi un clavier enrichi d’IA, capable de proposer non seulement des corrections mais des alternatives stylistiques. Tout cela rapproche la plateforme des chatbots concurrents tout en gardant l’accent sur la protection des données. Insight : l’IA devient l’interface, mais l’expérience dépendra du dosage entre local et cloud.

Scénarios d’usage concrets : Marion teste les commandes simultanées

Marion, architecte et utilisatrice d’iPhone, illustre l’apport pratique. En déplacement, elle pourrait dire : « Réserve une table à 12 h près de moi, partage la confirmation avec l’équipe et ajoute l’événement à mon calendrier ». Aujourd’hui, elle doit répéter trois commandes ; demain, Siri devra orchestrer les étapes et gérer les exceptions (table pleine, conflit d’agenda).

Un autre cas : lancer un parcours vélo, envoyer la trace à un ami et demander la météo du trajet — tout en gardant l’écran verrouillé. Ces flux montrent où les commandes simultanées offrent un vrai avantage. Insight : la valeur réelle se mesurera à la capacité de Siri à anticiper et à corriger sans heurter l’utilisateur.

Déploiement, contraintes et calendrier attendu

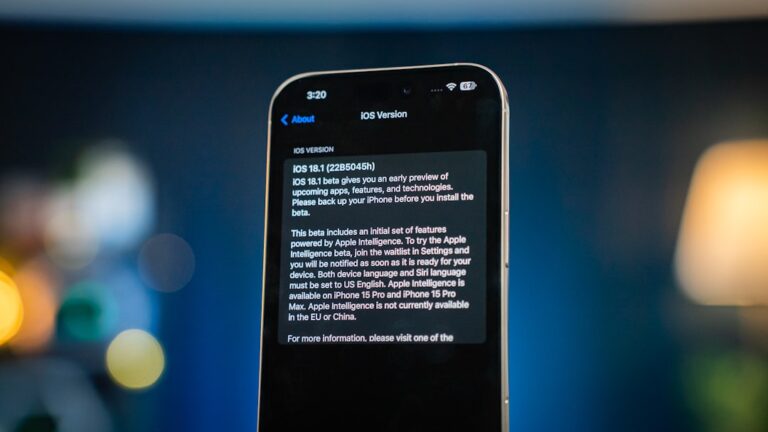

Apple présentera ces nouveautés lors de la WWDC qui débute le 8 juin 2026, mais la disponibilité effective pourrait s’étaler. L’entreprise prévoit une mise en service d’ici septembre, avec des fonctions étiquetées « Preview » pour signaler un stade incomplet. Certaines briques pourraient même être repoussées à des mises à jour ultérieures si les tests révèlent des risques ou des retards.

Par ailleurs, Apple explore des partenariats pour alimenter certaines capacités et teste différentes architectures (modèles embarqués versus services cloud). Les betas développeurs ne garantiront pas la présence immédiate de toutes les fonctions. Insight : attendez une distribution progressive, feature par feature.

Ce que cela signifie pour l’amélioration utilisateur et la technologie Apple

Transformer Siri en agent capable de traiter des requêtes multiples est un pari d’expérience utilisateur autant que de technologie. Si l’assistant devient capable d’anticiper, de négocier entre apps et de rester transparent sur ses choix, l’amélioration utilisateur sera sensible au quotidien.

Le basculement rapprochera Apple des standards établis par certains chatbots, sans renier les spécificités de la technologie Apple : confidentialité, intégration système et qualité matérielle. Pour suivre l’actualité des préparatifs et des possibles retards, cet article complémentaire sur les conséquences des retards liés à Siri apporte des éléments de contexte pertinents.

Pour un panorama des rumeurs et des choix d’interface, voir aussi l’analyse détaillée sur ce que nous savons sur le nouveau chatbot Siri. Insight final : l’impact réel dépendra moins d’un slogan marketing que de la capacité de Siri à tenir une conversation utile, sécurisée et prévisible.